SignGemma: la IA de Google DeepMind que traduce lenguas de señas a texto

Descubre cómo Sign Gemma, la IA de Google DeepMind, traduce lenguas de señas a texto y revoluciona la inclusión para personas sordas en todo el mundo.

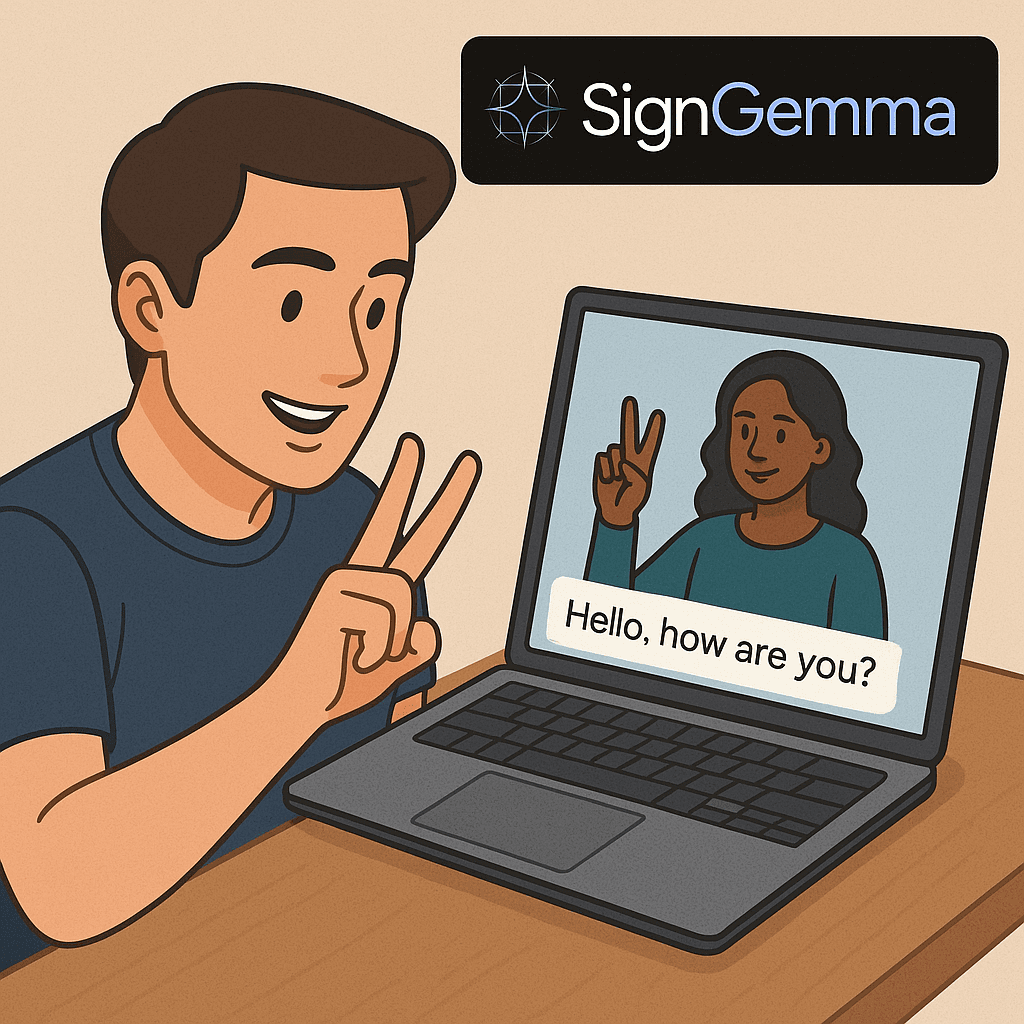

La inteligencia artificial no deja de sorprendernos, y uno de sus avances más emocionantes viene de la mano de Google DeepMind con SignGemma, un modelo diseñado para traducir lenguas de señas a texto escrito. Este desarrollo no solo es un avance tecnológico impresionante, sino que también tiene un profundo impacto social, ya que busca derribar barreras de comunicación para millones de personas sordas o con discapacidad auditiva en todo el mundo.

¿Qué es SignGemma?

SignGemma es un modelo de inteligencia artificial especializado que Google DeepMind ha entrenado para interpretar los gestos, movimientos y expresiones faciales propios de las lenguas de señas. A partir de videos o capturas en tiempo real, SignGemma puede reconocer estos signos y transformarlos en texto escrito, facilitando así la comunicación entre personas sordas y oyentes que no conocen lengua de señas.

¿Por qué es importante?

Inclusión social: Ayuda a cerrar la brecha entre comunidades sordas y oyentes.

Acceso a servicios: Permite que personas sordas puedan interactuar más fácilmente en entornos como bancos, hospitales, escuelas o servicios públicos.

Avance tecnológico: Representa un salto importante en el uso de IA para entender lenguajes no verbales, que son mucho más complejos que el lenguaje escrito o hablado.

¿Cómo funciona?

SignGemma combina varias tecnologías:

Visión por computadora: Analiza los gestos de las manos y las expresiones faciales en video.

Modelos lingüísticos especializados: Entiende el contexto y la gramática propia de cada lengua de señas (que no es universal, sino que varía por país).

Procesamiento en tiempo real: Ofrece traducción instantánea, algo clave para que la comunicación fluya naturalmente.

Google DeepMind ha entrenado a SignGemma con grandes volúmenes de datos, pero siempre teniendo en cuenta la privacidad y los estándares éticos, colaborando además con comunidades sordas para garantizar que la tecnología sea precisa y culturalmente respetuosa.

¿Qué desafíos enfrenta?

Aunque el avance es enorme, aún hay retos por delante:

Variedad de lenguas de señas: No existe una única lengua de señas; cada país (y a veces cada región) tiene la suya.

Detalles sutiles: Las expresiones faciales, la velocidad del movimiento y las diferencias individuales pueden dificultar la interpretación.

Accesibilidad tecnológica: Para que esta tecnología tenga impacto real, debe estar disponible y ser fácil de usar en dispositivos cotidianos.

¿Qué impacto puede tener a futuro?

Si SignGemma logra desplegarse ampliamente, podría transformar la forma en que interactuamos en servicios, espacios públicos, e incluso en redes sociales. Imagina, por ejemplo, videollamadas donde una persona sorda puede usar lengua de señas y la otra recibe el texto traducido en tiempo real.

Además, este proyecto podría abrir la puerta a nuevos desarrollos: traducción inversa (de texto a señas), asistentes virtuales que entiendan lengua de señas, o herramientas educativas para aprender y practicarla.

Reflexión final

SignGemma no es solo un avance de Google DeepMind; es un recordatorio de cómo la tecnología, bien aplicada, puede hacer del mundo un lugar más accesible e inclusivo. La inteligencia artificial muestra su verdadero potencial cuando se pone al servicio de las personas y de la equidad.

¿Qué opinas tú? ¿Cómo crees que la IA puede seguir ayudando a crear un mundo más inclusivo? ¡Déjame tus comentarios!