Protegiendo la IA Generativa: Cómo Combatir Ataques de Prompt Injection

Explora cómo las empresas pueden proteger sus modelos de IA generativa contra ataques de prompt injection, destacando las soluciones y servicios de Indrox NeuroCore.

Protegiendo la IA Generativa: Estrategias para Combatir Ataques de Prompt Injection

Introducción

En la era del desarrollo de software y la automatización de procesos, la inteligencia artificial generativa está transformando radicalmente sectores como el desarrollo de apps móviles y la creación de agentes IA. Sin embargo, esta revolución tecnológica también trae consigo desafíos significativos, especialmente en lo que respecta a la seguridad.

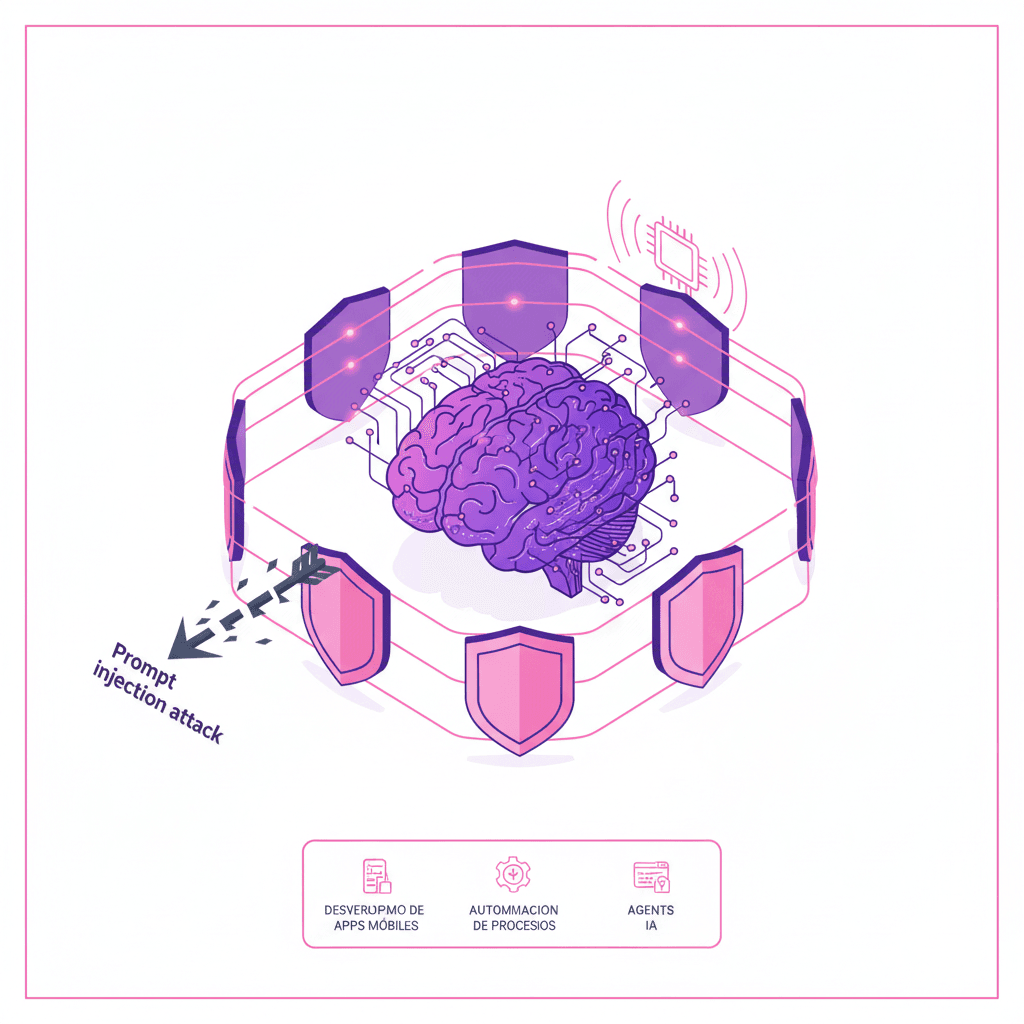

¿Qué es un Ataque de Prompt Injection?

Un ataque de prompt injection se produce cuando entradas maliciosas se introducen en sistemas de IA generativa, lo que puede alterar sus operaciones y resultados. Este tipo de ataque es particularmente peligroso porque puede llevar a la divulgación de datos confidenciales o incluso permitir el control externo de sistemas críticos. En el contexto del desarrollo de software y la creación de agentes IA, entender y mitigar estos riesgos es crucial.

Implementando Soluciones de Seguridad en IA

Para fortalecer la seguridad en el desarrollo de apps móviles y otros campos de IA, es esencial adoptar estrategias de seguridad robustas. La suite Indrox NeuroCore se destaca en este ámbito, ofreciendo integración de medidas de seguridad personalizadas que son vitales para la protección de sistemas de IA. Esta tecnología permite una supervisión efectiva y control riguroso de las interacciones con modelos de IA, ayudando a prevenir manipulaciones malintencionadas.

Casos de Uso y Ejemplos Prácticos

Examinando casos reales, podemos observar cómo diversas empresas han implementado con éxito estrategias de seguridad en sus procesos de desarrollo de software y creación de agentes IA para combatir los ataques de prompt injection. La adaptabilidad y las capacidades avanzadas de Indrox NeuroCore han jugado un papel crucial en reforzar la infraestructura de seguridad en una variedad de organizaciones, protegiendo sus desarrollos en el ámbito de la automatización de procesos y más allá.

Conclusión

Este artículo ha explorado los riesgos vinculados con los ataques de prompt injection y cómo se pueden implementar soluciones efectivas para proteger la IA generativa en campos como el desarrollo de software y la automatización de procesos. Indrox NeuroCore emerge como una herramienta esencial para asegurar que las implementaciones de IA no solo sean innovadoras, sino también seguras. Si estás interesado en fortalecer la seguridad de tus sistemas de IA, te invitamos a contactarnos para una consultoría gratuita.

Indrox

Equipo de tecnología de Indrox. Expertos en software a medida, inteligencia artificial aplicada y transformación digital para empresas en Perú y Latinoamérica.

Publicado el 25 de abril de 2026